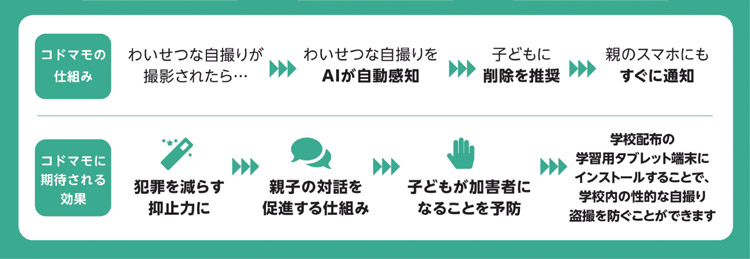

子どものスマートフォンの保存ファイルにある性的なわいせつ画像をAI(人工知能)が検知し、保護者のスマホに知らせるアプリを藤田医科大学などが共同開発し、このほど公開した。ディープラーニング(深層学習)でAIにわいせつ画像を覚えさせ判別する。画像の削除を促し、写真送信も事前に防ぐ仕組みで、AI技術を活用し社会的課題の解決につなげる。

藤田医科大学産官学連携推進センターの村川修一准教授(経営管理学)によると、愛知県警から「児童や生徒がわいせつな犯罪に巻き込まれている問題が深刻化しており、中にはそれを苦に命を絶つケースもあった」という相談が大学に持ち込まれた。

SNS(交流サイト)などで知り合った大人に自撮り写真を送信するよう強要されるといった事件が増えている。医療従事者を目指す教育の現場でできることはないかとワークショップ形式で授業を行い、学生からアプリを活用した防犯というアイデアが出た。

授業に産学連携で同席した藤田医科大の冨田直人客員講師が経営するスタートアップ企業「スマートブックス」(東京都世田谷区)で半年間、アプリ開発に取り組み、スマホ用の無料アプリ「コドマモ」をリリースした。子ども、保護者用をそれぞれインストールして使う。

スマホで写真を撮ること自体を規制することはできないため、コドマモでは子どもが自撮りした写真をAIが判別する。AIに肌の露出度からわいせつと人間が判断した画像を覚えるよう指示を出し、それに準じた写真が保存フォルダーに入った瞬間に保護者のスマホにアラートが入る。子どものスマホには画像の削除を促す仕組みだ。

元から備え付けられたカメラだけでなく、カメラアプリを利用していても、AIが保存機能を察知して瞬時に判断する。同時に位置情報も取得することができるため、子どもに急迫の危険があるときに通報や保護ができる。

冨田客員講師は「今後は動画フォルダーにも対応していきたい。今はAIの画像のディープラーニングだが、友人らとのやりとりでいじめに遭っている文言を検知する言語学習機能を搭載したAIも装備できたらいい」という。

村川准教授は「最初は大学側で解決できない難題と思ったが、産学連携が功を奏した。医療領域だけで解決できないことを先端技術が解決していくいい事例となった」と話す。

関連リンク

- 藤田医科大学プレスリリース「子どものわいせつな自撮りを AIで検知するアプリ『コドマモ』を3月30日(木)にリリース」

- コドマモ